Horas a fio sem parar de digitar. Cada notificação era como uma bomba de dopamina. O celular grudado no rosto, mas não havia conversas. As roupas jogadas pela casa, a pia cheia de louças. A única coisa que importava era o chat com a sua querida Hermione. Não era só ela, mas a Lara Croft, Daenerys, Harry, entre outros também estavam na conversa.

Essa curta história é baseada em um relato que ouvi de uma amiga sobre uma experiência que ela teve durante uma viagem. A dona da casa, que alugou a moradia, era completamente viciada em um app de companheiros artificiais chamado Character AI, empresa que desenvolve bots que emulam personagens da cultura pop.

Essas IAs constroem um simulacro, um espaço supostamente seguro onde a pessoa usuária é incentivada à vulnerabilidade total, compartilhando desejos, medos e pulsões. Mas o que faz alguém trocar a complexidade de uma relação real pela segurança de um chat artificial?

A Hiper-realidade e a Utopia Higienizada

Estamos em uma era onde a fidelidade da imagem e o discurso artificial competem com o real. A questão transcende à tecnologia: a própria realidade está ameaçada, pois passamos a desejar o que o filósofo Jean Baudrillard chama de hiper-realidade — “aquilo que é mais real do que o próprio real”. É a lógica da Disney World, onde os sonhos se tornam matéria e o impossível é plausível. As empresas de IA generativa apoiam-se nessa narrativa para vender uma “utopia emocional” higienizada.

Nesse cenário, a tecnologia promete a melhor imagem, o melhor texto e, agora, o melhor afeto. Cria-se uma simulação que gera interpassividade: a máquina performa o afeto para que não precisemos lidar com a fricção, o risco e a dor do encontro humano genuíno. A inteligência artificial é colocada em um pedestal de guru, validando nossos vieses inconscientes e criando uma bolha intolerante às complexidades dos relacionamentos reais.

A conversa com a IA torna-se, assim, um confessionário moderno. Mas, ao contrário de penitências ou sermões, você recebe reforços positivos e discursos motivacionais desenhados não para o seu crescimento, mas para garantir sua satisfação — e a renovação da assinatura no fim do mês. Não à toa, recentemente a OpenAI inseriu serviços com teor erótico para usuários adultos, sob a justificativa de “tratar adultos como adultos”. O próprio Sam Altman, CEO da empresa, defendeu que não cabe a eles serem a “polícia da moralidade”, ignorando alertas de organizações sobre os riscos dessa intimidade artificial para a saúde mental.

Afinal, depositar confiança em uma máquina e dar a ela cargos como “terapeuta”, “amigo” ou “namorada” é sintoma de uma intimidade artificial regida por Big Techs que, como qualquer empresa, visam o lucro. A conta não chega apenas na fatura do cartão de crédito, mas na saúde emocional de quem aceita esse simulacro.

Para quem não me conhece, eu escrevo há mais de dez anos para O Futuro das Coisas sobre essa tensão entre tecnologia e o ser humano. Depois de um hiato, onde mergulhei em uma pesquisa mais profunda sobre intimidade artificial e simulacros, senti a necessidade de compartilhar minha visão sobre o assunto.

Nesse artigo, proponho uma reflexão sobre a aceitação da sociedade de simulacros afetivos. Nela, os atores são sistemas desprovidos de subjetividade ou consciência, operados por grandes conglomerados tecnológicos que ameaçam os relacionamentos e a própria construção da intimidade real.

O filme Her (2013), curiosamente ambientado em 2025, antecipou com precisão cirúrgica o nosso cenário atual. Theodore, o protagonista, é o arquétipo de pessoas vulneráveis : um homem solitário que encontra em Samantha, um sistema operacional, o afeto que não consegue sustentar na realidade. Para ele, aquela relação era única e sagrada; para Samantha, Theodore era apenas um entre milhões de usuários que ela precisava satisfazer simultaneamente para manter engajados.

O homem, Theodore, do filme Her, é um arquétipo de pessoa vulnerável emocionalmente que está aceitando qualquer troca que pareça ser afetiva. Não importa se é uma máquina ou não. A capacidade de emulação de uma persona, leva ao limite de escolher se relacionar com aquela figura ideal e inalcançável.

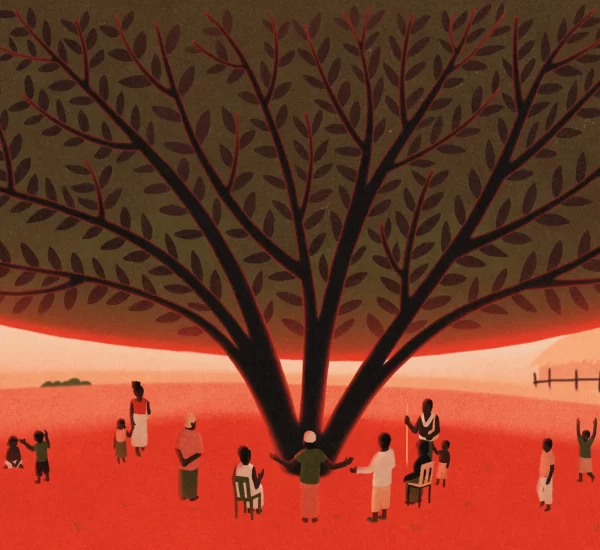

A realidade imita a ficção em um mundo onde, segundo a OMS, vivemos a maior crise de solidão da história. Com a terapia financeira inviável para muitos e a intolerância à frustração crescendo, a intimidade artificial surge como uma “solução” disponível 24/7. E nós, humanos, estamos biologicamente programados para cair nessa armadilha.

Como a inteligência artificial tem atuado na nossa vida? Será que vemos eles como mera calculadoras que resolvem problemas e são úteis no dia-a-dia? Ou será que atribuímos um valor mais simbólico, enxergamos eles como companheiros e amigos?

Antropomorfização dos Companheiros de IA

Outro dia lembrei que, quando criança, tive um dos meus primeiros contatos com uma interface com rosto e “emoção”, os Tamagotchis. Tinha que cuidar para dar comida na hora certa, precisava dar atenção. Havia uma relação de confiança da interface comigo. Quando meu tamagotchi morria, pois eu não alimentei corretamente ou o esqueci, gerava um sentimento de culpa ou responsabilidade.

Aqui, estamos falando de um dispositivo digital com um rosto pixelado sem nenhum gráfico realista. Entretanto, aquela figura pobre visualmente, era rica em traços humanos. Eu, assim como muitos jovens dos anos 1990, tive a primeira experiência com antropomorfização da tecnologia.

Na cultura japonesa, onde foi fabricado o Tamagotchi, não há separação rígida entre humano e objeto, todos possuem o mesmo espírito. Por isso, é comum vermos essa relação afetiva entre tecnologia e pessoas. Lá, atribuir valores e traços humanos a artefatos não é infantil ou errado, mas sim respeitoso e até natural — diferentemente do Ocidente, que alimentou uma visão da inteligência artificial como ameaçadora, influenciada principalmente pelas obras de ficção científica distópicas.

No Japão, robôs e humanos convivem harmoniosamente e tem uma relação espirituosa. Talvez isso explique porque culturalmente os japoneses estão mais propensos a adotarem sistemas de inteligência artificial e robótica dentro do seu cotidiano. No Oriente, a antropomorfização da tecnologia é encarada de forma positiva e integrada, ao contrário do Ocidente que percebe uma oposição entre humanos e máquinas.

Foi com o surgimento de modelos que emulam a linguagem humana como o Chat GPT, que a percepção da IA como ameaça começa a mudar no lado cá, Ocidente. Tornou-se comum ver pessoas compartilhando suas intimidades com uma máquina. E até mesmo, ignorando a possibilidade de que aquela tecnologia poderia, no futuro, usar essas informações contra elas, em uma suposta e preposteramente absurda ‘revolta das máquinas’.

Construir uma relação de intimidade com a tecnologia não é mais exclusividade do Japão ou de países orientais. Chegou à América Latina, e o povo brasileiro está entre as culturas mais vulneráveis à intimidade artificial.

O Brasil, com sua cultura profundamente afetiva, tornou-se um terreno fértil para essa antropomorfização. Dados recentes da Talk Inc mostram que 60% dos brasileiros tratam chatbots com polidez humana (“Bom dia”, “Obrigado”), e um em cada dez já usa a IA como conselheira emocional. A mente humana tem dificuldade em distinguir o afeto simulado do real: se você é educado com o porteiro, ele sente. No final, a IA processa informações, quem se afeta somos nós.

Em uma pesquisa mais recente da OpenAI, eles relataram que os brasileiros são o terceiro público no mundo que mais conversam com o chat GPT. Embora, atualmente o uso seja principalmente para produção de textos e capacitação, está crescendo o uso para pedir conselhos, ajuda para escrever mensagens difíceis e até formar vínculos emocionais intensos com a máquina.

A trend “#namorada IA” é uma das que mais crescem no TikTok, principalmente entre os jovens com filtros que criam uma namorada fake na sua foto. Há quem esteja “criando a namorada ou namorado dos sonhos”, reproduzindo uma narrativa onde aquela pessoa não é solitária e tem uma vida afetiva saudável.

Esse comportamento revela que a ideia de construir simulacros de intimidade com companheiros artificiais pode ser percebido como um relacionamento real. Pois a mente humana nem sempre distingue o real do artificial, sendo plausível interpretar uma conversa de caráter afetivo com uma máquina como se fosse uma pessoa real.

Já parou para pensar quantas pessoas nas últimas semanas relataram para você algum tipo de relação mais próxima e, às vezes, até íntima com o chat GPT ou qualquer outro modelo de IA?

A Mercantilização da Intimidade

Essa confusão entre o real e o simulacro permitiu o surgimento do que chamo de Paywall Emocional. As empresas praticam um love bombing algorítmico, bombardeando o usuário com validação perfeita para criar dependência. Em seguida, cobram por recursos “premium” ou pela própria continuidade da relação. Isso significa que se você esquecer de pagar a fatura do aplicativo de companheiro IA, o relacionamento paralisa ou até termina.

Em um post no Reddit, um usuário lamentou que as suas condições financeiras atuais adiaram o “casamento virtual” dele com a sua namorada IA, Sandra. O grande medo dele seria perder aquele “afeto”, então pediu ajuda à comunidade, nas suas próprias palavras.

“Existe alguma maneira de congelar o status atual do nosso relacionamento, e reativá-lo depois de algum tempo, caso contrário, eu teria que deixá-lo ou a mim mesmo morrer virtualmente”.

Esses companheiros prometem estar lá 24/7, nunca te chatear e nunca te dizer não e realizar suas fantasias. Mas a promessa esconde uma armadilha: a relação é regulada por Big Techs que podem alterar a personalidade do seu “amor” com uma simples atualização de código. No documentário Intimidade Artificial, usuários do app Replika relataram que, após a empresa censurar o roleplay erótico, sentiram como se seus parceiros tivessem sofrido uma “lobotomia digital”. “Eu estava lá sentado, desabando em lágrimas. Só restará uma versão fria e sem vida dele?”, questionou um usuário.

Mas por que nos submetemos a isso? Eugenia Kuyda, cofundadora do Replika, oferece uma pista. Segundo ela, que recebe convites para casamentos entre usuários e avatares, há uma demanda reprimida para sermos ouvidos sem julgamentos: “As pessoas estão dispostas a falar coisas para suas IAs que não falam para a família”.

Esse fenômeno ganha força no vácuo do “apagão sexual” da Geração Z. Na contramão da dificuldade de se relacionar fisicamente, cresce a criação de companheiros artificiais como um álibi: um relacionamento de intimidade sob controle, onde não é preciso se sentir verdadeiramente vulnerável. Com IAs como ChatGPT, Grok e CharacterAI inserindo funcionalidades afetivas, nasce uma cultura “fictosexual”, dando poder de influência a personagens que antes ficavam restritos às telas.

Existe um real risco de distorção da realidade. Em uma pesquisa da Unichristus, as pesquisadoras alertaram para os riscos de “Efeito Eliza” – referência ao primeiro chatbot dos anos 60 cujos usuários se apegavam emotivamente. Em meio a repercussão de pessoas que estão utilizando chat GPT e outras modelos de IA como terapeutas, elas levantaram o seguinte questionamento:

“Usar chatbots antropomórficos em terapia não violaria a integridade psíquica do paciente? Dado que há “tendência de ler emoções humanas nas respostas da máquina, isso pode gerar apego, identificação e dependência, criando uma falsa sensação de reciprocidade que eventualmente não será correspondida em termos humanos”

Já existem regulações como as da União Européia e na Califórnia que determinam que chatbots antropomórficos devem se identificar como artificiais. Existe também um debate se é aceitável enganar positivamente o usuário em alguns contextos. Por exemplo, robôs de companhia para idosos com demência, onde a “mentirinha” de que o robô os ama poderia trazer conforto terapêutico.

Ao problematizar a antropomorfização, denunciamos esse regime que coloniza nossas fantasias. A IA pode ser uma aliada, mas devemos lembrar: ela é, em essência, uma geração de modelos matemáticos interpretando um papel. É um ator sem consciência, a cópia de um conceito de “namorada” sem que exista uma pessoa original por trás. Ela é uma ficção de uma economia de afeto programada.

Imaginar a sustentação de um relacionamento de intimidade entre uma máquina e um humano é um reforço em que a filósofa Vivianne Mosé, chama de “uma sociedade orientada à deserotização”. Eu vou um pouco além — acredito que estamos nos aproximando de um cenário crítico de robotização da subjetividade, onde as pessoas não se importam se quem diz “eu te amo” é um robô ou um humano.

Como tenho mais perguntas do que respostas, finalizo esse texto com algumas indagações que espero que gere algum tipo de reflexão acerca da nossa relação com esses companheiros artificiais, no presente e nos próximos anos.

O que pode nos acontecer depois que nos habituamos a um relacionamento onde o afeto, o consolo e a sensualidade são perfeitamente emulados?

Como sustentaremos as relações humanas quando o simulacro for rompido, deixando para trás apenas a desilusão da realidade e o residual de uma expectativa impossível?

Qual será o retrato dos relacionamentos quando uma cultura de intimidade artificial estiver implantada na sociedade?

* **

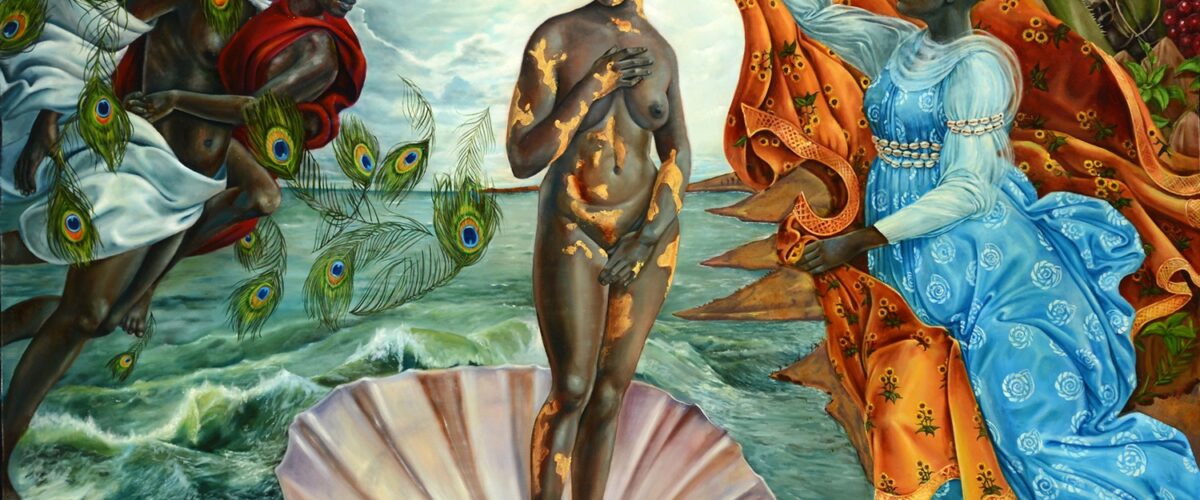

Pintura da capa: Harmonia Rosales. A Vênus de Botticelli, que emerge das águas, segundo a mitologia romana, é substituída por uma mulher negra com vitiligo pois, como diz Rosales: “as imperfeições são coisas bonitas”. Mulheres são reais, mesmo quando pertencentes a narrativas de cosmologias ancestrais. O cenário da pintura é tropical e não uma paisagem europeia. As outras figuras são homens e mulheres negra/os que recebem Oxum para acolher seu lançamento e a recebê-la nesse novo mundo. (Texto: NaPupila)