Como neurocientista, já ouvi essa pergunta mais de uma vez. Minha resposta é sempre a mesma: possível é. Muitos avanços estão ocorrendo nesse sentido, os quais abordarei a seguir. Porém, para mim, outra pergunta é muito mais importante: QUANDO será possível?

A partir de tudo que vejo no ramo, muitos anos ainda serão necessários para que uma tecnologia, que leia um pensamento por completo, seja uma realidade. Isso significa que temos tempo para decidir como, para quê, ou mesmo se, queremos essa tecnologia.

Porque é possível?

De um ponto de vista científico, acredita-se que a informação está gravada no cérebro na sequência de ativação dos neurônios e na sincronia entre eles, entre outros fatores. Existem várias correntes da neurociência com crenças diferentes sobre onde a informação está armazenada, mas todas elas identificam um evento físico que guarda a informação. Logo, se a informação está armazenada fisicamente, ela é passível de ser lida, assim como nossa bioquímica individual hoje pode ser identificada pelo mapeamento genético.

Por exemplo, memórias específicas já foram mapeadas em ratos, apagadas e reativadas conforme a vontade dos cientistas. Nesse estudo, quando a memória foi criada pelos pesquisadores (um choque associado a uma gaiola específica) o animal geneticamente modificado tinha eletrodos dentro do cérebro, o que permitiu rastrear a informação. Em macacos, já foi possível reconstruir rostos sendo lembrados simplesmente “lendo” quais neurônios do córtex visual estavam sendo ativados. Entretanto, em ambos os casos os métodos usados foram invasivos, o que dificulta aplicação de algo similar em humanos.

Em nossa própria espécie o método de preferência para esse tipo de estudo é o eletroencefalograma (e seus derivados), eletrodos colocados externamente sobre o crânio, método muito usado em diagnósticos médicos. Já existem alguns dispositivos comerciais capazes de perceber o estado de relaxamento do indivíduo através das diferentes frequências cerebrais.

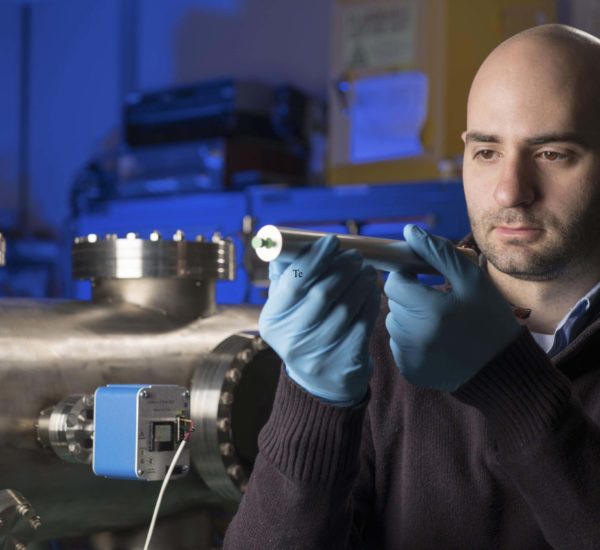

Mais impressionante são os dispositivos para controlar o movimento de exoesqueletos com o pensamento, como por exemplo foi desenvolvido pelo brasileiro Miguel Nicolelis. Este mesmo pesquisador agora trabalha no desenvolvimento de uma “Brainet”, uma rede de comunicação direta entre cérebros.

Também este ano houve um press release da Toyohashi University of Technology no Japão em que cientistas alegam ter desenvolvido uma tecnologia capaz de identificar o pensamento de números e algumas palavras monossilábicas.

Há ainda Elon Musk com o ambicioso projeto Neuralink, o qual tem objetivo de desenvolver uma interface humano-máquina, porém ainda paira um grande mistério de como pretende fazer isso.

Exceto por este último, sobre o qual não temos muitas informações, os esforços atuais estão focados em dispositivos que decodificam um único tipo de informação de cada vez (movimento, linguagem, imagens). Não há dúvida de que estes se tornarão comerciais daqui alguns anos. A cada ano novas modalidades mais complexas de informação estão sendo traduzidas a partir da atividade cerebral, porém para ser capaz de ler qualquer tipo de pensamento não importando a modalidade da informação ainda há desafios.

Quais são os impedimentos?

Primeiramente existem impedimentos técnicos. Ler pensamentos significa ser capaz de identificar qualquer informação que passa pelo cérebro e filtrar das outras atividades que estão ocorrendo simultaneamente (informações relativas à batimento cardíaco, respiração, movimento, sensações, entre muitas outras). Um pensamento pode ativar áreas responsáveis por diversas atividades e não é tão simples muitas vezes diferenciar, olhando para o cérebro, uma ação que está só no pensamento de outra que está ocorrendo na realidade.

Também é tecnicamente impeditivo o volume de informação. Poucos minutos de gravação de algumas dezenas de neurônios hoje geram vários terabytes de dados. Para ser capaz de ler pensamentos, seria necessário monitorar bilhões de neurônios ininterruptamente. Para muitos a preocupação com o limite de memória do computador já não existe mais, mas na neurociência ainda sonhamos com hard drives infinitos.

Além disso, monitorar bilhões de neurônios um a um separadamente também é sonho. Quando gravamos algumas dezenas, fazemos isso espetando microeletrodos diretamente neles. O eletroencefalograma que usamos em humanos só consegue identificar a atividade de milhares de neurônios juntos, pois cada eletrodo cobre uma área muito grande e só em conjunto as células geram sinal suficiente para atravessar o crânio sem se dissipar. Esta técnica, ainda muito usada nesse tipo de interface humano-máquina, talvez não seja a mais adequada para desenvolver dispositivos precisos de leitura cerebral.

Estes são só alguns dos muitos problemas que os pesquisadores nessa área estão enfrentando. Entretanto, do meu ponto de vista, é só uma questão de tempo até que questões técnicas sejam resolvidas. O desenvolvimento da neurociência com certeza vai ocorrer atrelado ao de outras áreas, como por exemplo a evolução de computadores quânticos ou da inteligência artificial.

Em segundo lugar, porém, existem duas questões que ainda precisam ser resolvidas, as quais não necessariamente dependem somente da capacidade da tecnologia, mas sim de raciocínio: decifrar o código neural e a individualidade do pensamento. Ler uma memória específica, gerada sob monitoramento é algo bem diferente de ser capaz de saber o que todo e qualquer código de ativação significa. Um mesmo neurônio pode codificar informações diferentes dependendo da situação, e é a combinação de neurônios ativados que traz o significado, o que adiciona outro nível de complexidade para a situação (acredito que a evolução da inteligência artificial e do deep learning será primordial para solucionar este problema).

Além disso, não há nenhuma evidência de que existem as mesmas células que codificam as mesmas informações em indivíduos diferentes. Um dispositivo capaz de ler pensamentos precisaria aprender o código em cada indivíduo específico. E fica a questão de como traduzir essa informação tão individual para a linguagem de outro cérebro ou de uma máquina. Sabe tudo aquilo que não conseguimos colocar em palavras? Seria necessário ser capaz de traduzir em uma linguagem comum, que outros pudessem entender, porque esse é o conceito de algo que pode ser lido. Ser capaz de visualizar a ativação do cérebro é uma coisa, entender o que ele está dizendo em detalhe pode ser outra bastante diferente.

Quando externamos um pensamento, sabemos que muita da informação que passou por nossa mente foi filtrada antes de virar ação, palavras ou gestos. Uma tecnologia capaz de olhar diretamente no cérebro seria capaz de acessar a informação bruta, que muitas vezes ainda está sendo trabalhada por nós, e que, muitas vezes decidimos que é melhor não expressar. E assim, como nós simplificamos a informação para que os outros entendam, a tecnologia precisará fazer o mesmo para transformar o código neural em 0s e 1s. Porém, nesse caso, a simplificação ficará nas mãos de um algoritmo ao invés de nossa própria decisão.

Por isso, ficam pra vocês alguns questionamentos que atormentam meu dia-a-dia de trabalho:

Porque queremos ler pensamentos? Não seria essa nossa última instância de privacidade? Qual o impacto de usar a linguagem de computadores ao invés da linguagem escrita ou falada para nos comunicarmos?

Muito boa a matéria, simples mas completa e objetiva.

Acho desnecessário a leitura de mentes, mas penso que se isto acontecer resolveremos diversos problemas humanos ligados a doenças e demandas nas neurociências, coma, tratamento por sugestão, reprogramação do cérebro, sobre vida a pessoas em estado vegetativo (pelo menos de interação) entre outras coisas, mas tenho certeza que este não seria o objetivo nuclear de tal tecnologia.