A inteligência artificial e a aprendizagem da máquina estão evoluindo a tal ponto que podem estar alcançando o limite da ética, ao ditar se os seres humanos têm ou podem desenvolver comportamentos de risco.

Um novo estudo da Universidade Shanghai Jiao Tong, na China, alega que a AI pode determinar se uma pessoa se tornará criminosa, baseada apenas na análise de suas feições.

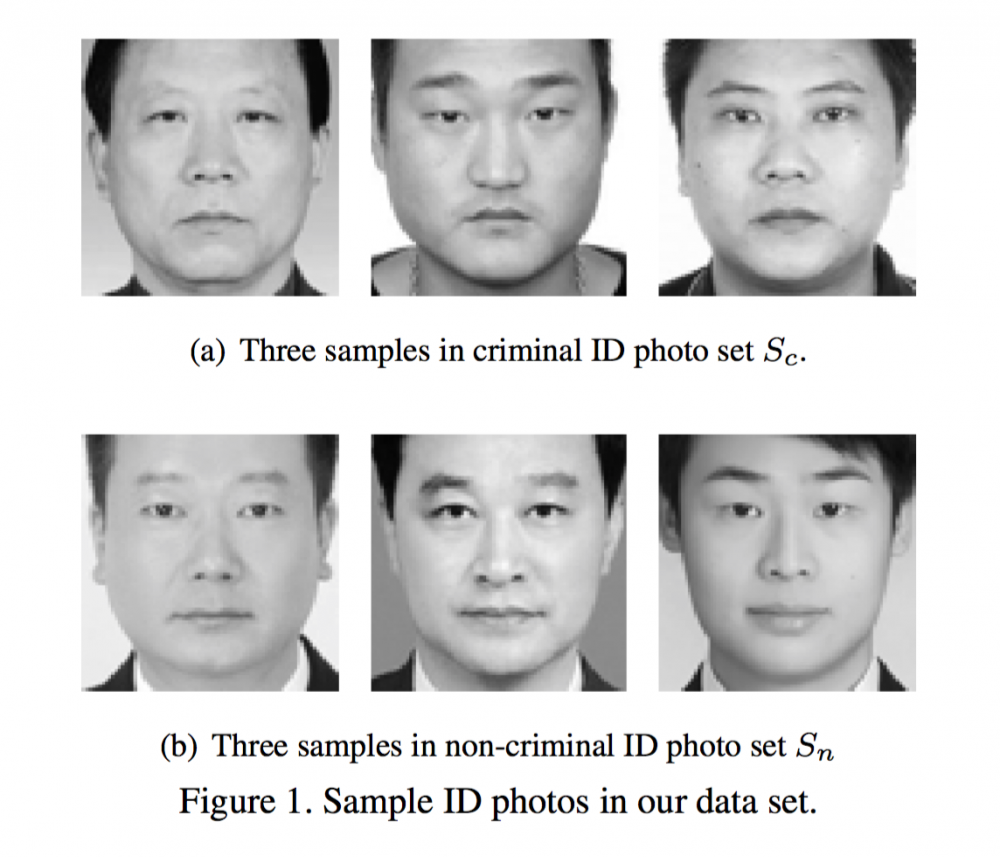

No artigo “Inferência automatizada da criminalidade através de imagens faciais”, dois pesquisadores dessa universidade disseram que fizeram o upload de imagens faciais de 1.856 pessoas em computadores e descobriram atributos estruturais distintos que identificam traços de criminalidade, como a curvatura labial, a distância entre as córneas internas e o ângulo entre a boca e o nariz.

Segundo o estudo, os 3 exemplos de cima (a) são de pessoas com “ID criminal”. Os exemplos de baixo (b) são de pessoas “sem ID criminal”. (Crédito: Universidade Shanghai Jiao Tong)

Os pesquisadores concluíram que quatro classificações têm resultados razoavelmente consistentes e confirmam a validade da inferência da criminalidade automatizada baseada nas feições, “embora esse assunto seja historicamente polêmico”.

Pseudociência

Durante centenas de anos, buscou-se inferir traços de moralidade num indivíduo, pela psicologia e algumas formas de fisiognomia, embora estas tentativas tenham sido rejeitadas há muito tempo pela comunidade científica.

Por exemplo, a frenologia, uma teoria que reivindica ser capaz de determinar o caráter, características da personalidade, e o grau de criminalidade pela forma da cabeça, foi desacreditada na época da Revolução Industrial, quando alguns adeptos da pseudociência ainda defendiam que o formato da boca ou a extensão das pálpebras poderia determinar se uma pessoa viria a se tornar um estuprador ou um ladrão.

Esse novo estudo pode ser extremamente grave: os seus autores acreditam que computadores são capazes de detectar a propensão à criminalidade escaneando imagens de lábios, olhos e narizes. Essa pesquisa pode deixar a frenologia no chinelo.

Os autores invocam o argumento – para justificar suas principais conclusões – de que computadores não podem ser racistas, pois são computadores:

Diferente de um avaliador/examinador humano, a visão algorítmica computacional ou classificador não tem nenhuma bagagem subjetiva, emoções ou preconceitos baseados em experiências passadas com etnia, religião, ideologia política, sexo, idade, etc., não sofre de fadiga mental e nem se importa se tiver dormido ou comido mal. A inferência automatizada de criminalidade elimina por completo a variável da meta de acurácia (a competência do avaliador/examinador humano). Além da vantagem da objetividade, algoritmos sofisticados baseados em aprendizado de máquina podem descobrir nuances sutis e elusivas nos atributos e estruturas faciais associadas a traços de personalidade inatos, que passariam desapercebidas para uma pessoa leiga, sem treinamento.”

Esse argumento ignora o fato de que todo software é desenvolvido por pessoas, e pessoas, não estão livres de preconceitos, podendo inferir a criminalidade a partir de traços faciais.

Em nenhum ponto da pesquisa é mencionado se esse software pode ser usado de forma abusiva por parte de agências de segurança.

Kate Crawford, pesquisadora de AI do Microsoft Research New York, MIT e NYU, falou ao site The Intercept que chamaria essa pesquisa de frenologia pura. “A única diferença é que estão usando ferramentas modernas de aprendizado automático supervisionado, em vez de paquímetros”.

Crawford alertou que, “à medida que entramos em uma era de policiamento preditivo – baseado na previsão de fatos – é importante analisar de forma crítica o uso problemático e antiético do aprendizado automático para estabelecer correlações espúrias”, acrescentando ser evidente que os autores “sabem dos problemas éticos e científicos da pesquisa, mas a ‘curiosidade’ pode ter sido o fator motivador”.

Esse estudo nos leva a refletir sobre o que defende o futurista Gerd Leonhard, reconhecido em 2015, pela revista Wired, como um dos mais influentes pensadores europeus: dentre as inúmeras áreas de progresso tecnológico, a Inteligência Artificial será o mais significativo desafio que a humanidade irá enfrentar, no sentido que que pode ser uma moeda com duas faces, uma “paradisíaca”(heaven) pelos benefícios que traz e outra “infernal” (hell) pelos perigos que poderá causar.